ユニバーサル・ミュージアムをめざして83

人は人の〈ことば〉を待っている

三谷 雅純(みたに まさずみ)

今、やっている研究は、ある失語症者に人工的に合成した音で機械に音読をさせて、短い文章を聞いてもらおうと思ったことがきっかけでした。肉声ではありません。ロボットのような「声」、というよりもただの「音」と言った方がよいと思います。その男性はたいへん知的な方なのに、失語症のために普通に書いた文章は読み取れません。表音文字の平がなやカタカナが分からないとおっしゃいます。そこで合成音声で文章を読み上げてみたらどうだろうかとコンピュータをお持ちして試していただいたのです。

合成音声で文章を読み上げるときは、読んでいる位置がはっきり分かるように、後ろが黄色く反転するものが多いのです。こうすることで見たときに、どこを読んでいるかがわかりやすくなります。一方、失語症でない人は読み上げた文章を聞くとき聴覚が働きますから、本来、目に頼らなくてもいいはずです。その方は合成音声で「喋る」文章を「聞いてみて」、その瞬間、目が輝きました。何を言っているのかまでは分かりませんでしたが、「コンピュータが何かを喋っている」ことは分かったそうです。それまでとは異質な感覚があったのでしょう。

試していただいたのは、わたし以外の失語症者の認識を、わたしが、あれこれ経験し始めたばかりの頃でした。疲れていなければ、わたしは文章を黙読することに不自由はありません。ただし疲れていると、黙読しても頭に入る文章が断片的になります。その結果、読み取れなくなります。そんな時、わたしの場合は「日本語音声合成エンジンに読み上げてもらうと文章の意味が理解できる」ことに気がつきました。日本語音声合成エンジンの人工音声は何種類かが選べます。女性の声や男性の声、子どもの声などです。わたしは女性の声を選んで使っていたのですが――「魅力的な声」というよりも、あくまで機械が作るロボットに近い声です――喋った内容は、わたしにとって、よく理解できたのです。この経験がありましたから、ひょっとしたら先ほどの男性も理解できるのではないかと考え、それで試していただきました。

この男性の「文章を人工合成音で読み上げた音を聞いたら目が輝いた」という結果は、わたしに勇気を与えました。そして、いろいろな側面から「なぜ目が輝いたのだろう」と考え、マルチメディアDAISYに行き当たりました。

DAISYはもともと視覚障がい者の読書用に開発された技術です。多くの人は文字を視覚で捕らえます。視覚を使わない人に、普通の本(点字で書いていない本、つまり墨字(すみじ)の本)は読めません。そこで視覚を使わない人にも本を読んでもらいたいと考えた人が、録音を利用して内容を聴覚で捕らえるように工夫したものです。はじめはボランティアさんに吹き込んでもらっていましたが、コンピュータ技術が進歩したおかげで、機械だけでも「音声まがい」の音が出せるようになりました。DAISYは日本語音声合成エンジンを利用する「磁気情報で表した文章」といったイメージです。だからコンピュータとか専用の読み出し機がなければDAISYは読めません。

マルチメディアDAISYは、このDAISYに、さらに絵や写真などが付けられるように工夫したものです。研究によって、マルチメディアDAISYは視覚を使わない人だけでなく、文字の識別しにくいディスレクシアの人、学習障がいの人にも理解しやすいことが分かりました。そればかりではなく、その他のさまざまな「文字」に取っ付きの悪い人にも読書ができると分かってきたのです。わたしは最初、マルチメディアDAISYで作ったいろいろな文章――絵本や展示解説――を試していただき、何人かの失語症者や高次脳機能障がい者に理解できることを確かめました。しかし、中にどうしても分からないという人もいました。とくに人の肉声でなく合成音声、つまりロボットのような声で喋るのが分かりにくいという人が多くいました。(1) それはなぜだろうと考え、多くの失語症者や高次脳機能障がい者にわかってもらえるものは,どのようなものだろうかと、あれこれ考えたのが,このわたしの研究です。(2)

☆ ☆

普通の紙に書いた文章よりも、マルチメディアDAISYで分かる人が増えるのは、いくつかの脳の感覚をともに刺激するからではないでしょうか。音声以外の例をあげます。失語症で音の繋がりが言語に結びつかない人の場合、「文字」なら意味が分かるのではないか。なぜなら「文字」は目で見る視覚刺激だからです。もちろん点字は指先で触って感じる文字ですが、ここでは取りあえず置いておきます。

あるいは「文字」であっても、失語症者や高次脳機能障がい者にとっては、表音文字か表意文字かでわかりやすさが異なる。わたしに失語症者の文字理解について手ほどきをしてくれた男性のように、表音文字の平がなやカタカナは分からないが、表意文字の漢字なら分かるという方がよくいます。漢字や絵と平がなやカタカナでは、脳の中で、解釈を担う部位が違うからというのが理由だそうです。マルチメディアDAISYは音と文章、それに絵や写真で構成された表示形式ですから、その内どれかが理解できるのではないか。

これがわたしが最初に考えた失語症者や高次脳機能障がい者にわかりやすい「文章」の仕組みでした。でも、これではまるで機械です。つまり機械の部品のように、脳はパーツが組み合わさって精巧な働きをしているというイメージです。失語症や高次脳機能障がいはパーツのいくつかが壊れてしまった。だから,壊れてしまったパーツはあきらめて、別の働きの異なるパーツを増やして、そのどれかで代行させよう。わたしは最初、そう考えたということです。

この認識は、すぐに間違っていることに気がつきました。わたしの例で説明しましょう。すでに示した人工的に合成した音で機械に「音読」してもらうこととは別のことです。

例えば長い文章があったら、まだ元気な内は読んで理解できます。そして疲れてくると、だんだん理解が難しくなってきます。どんな具合に難しくなるのかを振り返ってみれば、読んでみて心の中で「音」にすることはできるのですが、その「音」の「意味」が理解できないのです。

別に失語症や高次脳機能障がいでなくても、似たことは多くの人が経験しているはずです。でもそんな時、読みやすくする方法があります。それは読みたい言葉に赤い下線を引いたり、黄色のマーカーで強調することです。あるいはフォント、つまり字のデザインを変えて見やすくすることです。人によるのかもしれませんが、わたしは太いフォントにすれば見やすくなります。行間を空けることも効果があります。そして決定的なのは、ちょうどこの文章でしているように、意味の切れ目で文章を分けることでした。

コンピュータであれば、そのようなことは簡単です。下線やマーカーは自由に引けますし、フォントを変えることも、行間を空けることも、すぐにできます。「意味の切れ目で文章を分ける」というのは、意味が変わったら空の一行を挟むということです。

これらは「視覚情報を加える」ことです。文章を読む時、黙読であっても、いったん心の中で「音」にして、その「音」が言語音なら、それに対応するイメージを思い浮かべる。そういった過程が必要です。しかし、下線やマーカー、フォントの違いは、基本的に視覚的なイメージです。ですから、視覚的なイメージから、いったん心の中で「音」にする「文字」とは関係がないはずです。でもこのような「視覚情報を加える」ことで、わたしは明らかに読みやすくなりました。これはいったい何でしょう?

難しい言葉ですが「多感覚統合」と呼ばれる現象です。「多感覚統合」が人のコミュニケーション行動に見られれば「多感覚コミュニケーション」(3) になります。

「多感覚統合」は新しく研究され始めたテーマです。なぜ「多感覚統合」が起こるのか、その細かな脳内で起こるメカニズムはとりあえず置いておいて、具体的にどのような現象なのか、何の役に立つのかが盛んに研究されています。わたしは「多感覚統合」や「多感覚コミュニケーション」という現象を知ってから、この現象は失語症者や高次脳機能障がい者にわかりやすい放送法やコンピュータを使った文章作成法にも応用できるのではないかと考えました。

☆ ☆

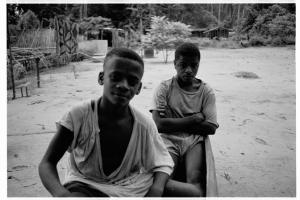

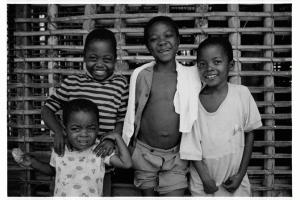

アフリカの森の夜、一日の仕事----わたしの調査の手伝いや狩り----を終えた狩猟採集民のピグミーたちは、焚き火を囲んで輪になります。その日のできごとを、身振りや手振りを交えて、おもしろ可笑しく仲間に語って聞かせるのです。森にお酒はありませんが、お酒があれば、もっと大げさな身振りになるのでしょう。

今朝、ミタニはゾウ道でメスのチンパンジーに出会った。

チンパンジーは逃げもせず、興味深そうな顔をして、地面にしゃがんでいた。

ミタニは双眼鏡を出して、チンパンジーの顔を覗いた。

するとチンパンジーは厭がって、背中を向けた。

ミタニも覗くのは止め、双眼鏡を下ろした。

チンパンジーはミタニの方をちらりと見た。

もう一度、ミタニはチンパンジーの顔を覗いた。

チンパンジーは、また背中を向けた。

これだけのことを、身振り手振りを交えて延えんと語るのです。小一時間にもなるでしょうか。さほど可笑しいことだとも思えません。しかし、みんなは笑い転げています。わたしも、つられて笑ってしまいました。

これが人と人のコミュニケーションの本質です。言葉は大切です。ただ言葉だけではなく、そこにジェスチャーや大げさな表情が加わると、ついつい笑ってしまうのです。焚き火の輪の話は、カバが歩いてきてミタニのテントを見ると驚いて止まった話だとか、夜中になるとテントの近くに(ウシの仲間の)ダイカーが表れるのは、塩味ほしさにミタニがしたオシッコを舐めに来ているのだとかいった話になることもあります(大げさに聞こえますが、本当に語り合っていたことです)。

もともとピグミーの世界に文字はありません。あるのは話し言葉と表情や身振り・手振りです。このような狩猟と採集に頼った生活と夜の焚き火の楽しみは数十万年に渡って、言葉を使って喋り合うことだけなら100万年ほども続きました。多分、この狩猟採集時代に形づくられたものの感じ方が、わたし達の脳の構造の原型を形づくったことは間違いありません。

こうして成り立つ会話が「多感覚統合」の見本です。対面でするコミュニケーションは「多感覚統合」の代表です。

確かに会話は言葉だけでも伝わります。しかし伝わることは無味乾燥です。決して「高揚感」は表せません。表情や身振り・手振りのジェスチャー――気分が乗ってくるとダンスまでが重なって「高揚感」が表れます。時にはその「高揚感」が昂じてトランス状態に陥ることさえあります。

わたし(=ミタニ)をダシに笑い興じている分には、トランス状態にまで陥ることはないのですが、表情や身振り・手振りといった目から入る刺激が言葉のもたらすイメージを拡大していることは事実です。このような「多感覚統合」によって、失語症者や高次脳機能障がい者で文字がわかりにくい人には役立つかもしれません。言語音だけではイメージに結びつかない失語症者や高次脳機能障がい者も、ひょっとしたら小さな核が拡大されて、イメージが生き生きと広がるかもしれない。失語症者や高次脳機能障がい者は年相応の理解は保っているのだから、ちょっとして刺激から理解可能なイメージが再生できるかもしれない。

わたしはそんなことを考えました。

人は家族やコミュニティの中で暮らしています。そこで人はいつも誰かの〈ことば〉を待っているのです。

------------------------------------------------------------------------

(1) 三谷 (2012) DAISYを使ったコミュニケーション障がい者にもわかりやすい展示解説の試み.人と自然 Humans and Nature 23, 61-67.

http://www.hitohaku.jp/publication/r-bulletin/No.23-061-1.pdf

(2) 三谷 (2015) 聞くことに困難のある人がわかりやすい音声: 視覚刺激の付加により高次脳機能障がい者の理解は進むか. 人と自然 Humans and Nature 26, 27-35.

http://www.hitohaku.jp/publication/r-bulletin/NO26_004-1.pdf

(3) 田中 章浩, 積山 薫 (2011) 特集「多感覚コミュニケーション」の編集にあたって. 認知科学.

https://www.jstage.jst.go.jp/article/jcss/18/3/18_3_381/_pdf

雑誌「認知科学」に「多感覚コミュニケーション」の特集が組まれていて、J-Stage から幅広い論文を無料で見ることができます。同じ雑誌に載っていた代表的な論文では:

田中 章浩 (2011) 顔と声による情動の多感覚コミュニケーション

https://www.jstage.jst.go.jp/article/jcss/18/3/18_3_416/_pdf

は「顔と声による情動」の研究成果をまとめてあります。また、

高橋 麻衣子, 巌淵 守, 河野 俊寛, 中邑 賢龍 (2011) 児童の読み困難を支援する電子書籍端末ソフトTouch & Readの開発と導入方法の検討

https://www.jstage.jst.go.jp/article/jcss/18/3/18_3_521/_pdf

は「多感覚コミュニケーション」を応用した読み困難を支援する電子書籍端末ソフトについて検討した結果が載っています。

三谷 雅純(みたに まさずみ)

コミュニケーション・デザイン研究ユニット

兵庫県立大学 自然・環境科学研究所

/人と自然の博物館